一、实验课时

2课时 设计型

二、实验目的

1.学生能够表述常用HDFS API编程的作用、原理

2.学生能够搭建HDFS API编程的运行环境

3.学生能够使用HDFS常用的API编程操作文件

三、实验内容

1.搭建本地HDFS API编程运行环境

2.使用HDFS API编程完成实验任务

四、实验原理

Hadoop的API允许开发者编写可以运行在Hadoop集群上的程序。使用Hadoop API时,需要遵循一定的稳定性准则,这些准则定义了不同版本间API的兼容性,Hadoop的Java API提供了对HDFS的访问能力,使得开发者可以在不知道分布式底层细节的情况下,开发分布式程序。通过API,可以实现文件的创建、读取、写入和删除等操作。例如,使用FileSystem API可以查询流的功能,动态调整流以适应不同的实现和环境。Hadoop的REST API为各种下游和内部应用程序和服务提供了主要接口,并且对REST客户端进行了版本控制,以确保端点本身以及支持的参数列表和输出在REST端点版本内不会发生不兼容的更改,Hadoop的API和原理是为了简化大规模数据集的分布式处理,使得开发者能够更容易地构建和运行处理大数据的应用程序。

五、实验流程

本实验在IDE开发环境(例如Eclipse、Pycharm等)中使用Java或Python完成HDFS API 编程。Eclipse的使用和配置,请查看本指导书末尾的附录。

现在要执行的任务是:

假设在目录“hdfs://localhost:9000/user/hadoop”下面有几个文件,

分别是:file1.txt、file2.txt、file3.txt、file4.abc和file5.abc,

这里需要从该目录中过滤出所有后缀名不为“.abc”的文件,

对过滤之后的文件进行读取,并将这些文件的内容合并到文件

“hdfs://localhost:9000/user/hadoop/merge.txt”中。

实验的基本任务如下:

1. HDFS API编程准备

2. HDFS API创建文件

3. HDFS API 合并文件

实验的基本任务的实现步骤如下(Java):

六、 在Linux中安装Eclipse

6.1 Eclipse是常用的程序开发工具,本教程很多程序代码都是使用Eclipse开发调试,文件名是eclipse-4.7.0-linux.gtk.x86_64.tar.gz。假设安装文件下载后保存在 了Linux系统的目录“~/Downloads”下,下面执行如下命令对文件进行解压缩:

cd /opt

tar -zxvf ./eclipse-4.7.0-linux.gtk.x86_64.tar.gz -C /opt然后,执行如下命令启动Eclipse:

cd /opt/eclipse

./eclipse

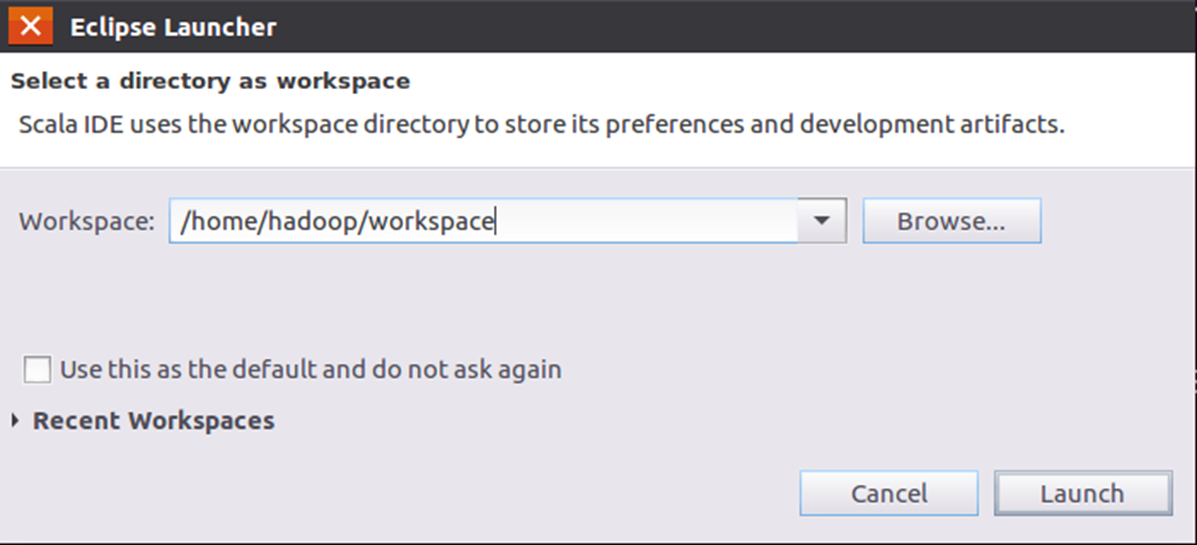

6.2 可以直接采用默认的设置“/home/hadoop/workspace”,点击“Launch”按钮。可以看出,由于当前是采用hadoop用户登录了Linux系统,因此,默认的工作空间目录位于hadoop用户目录“/home/hadoop”下。

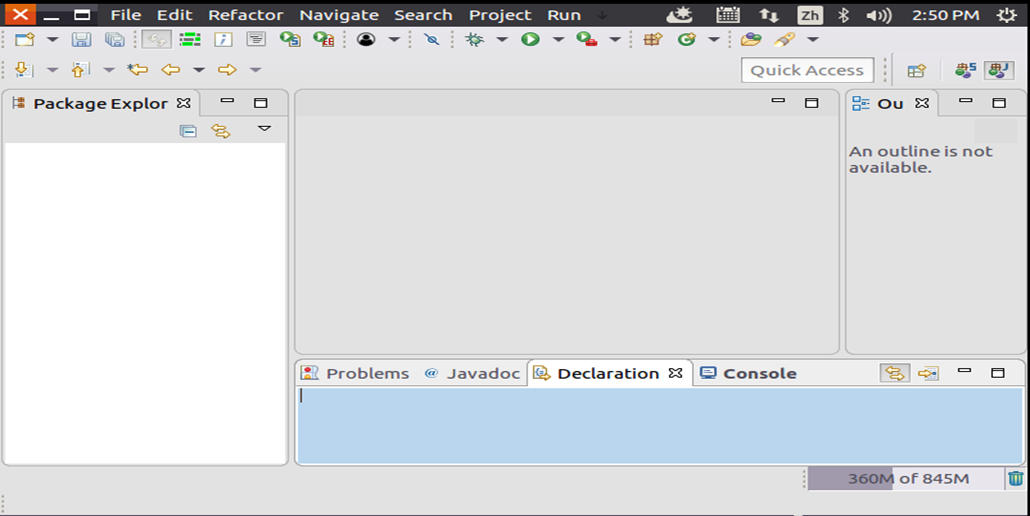

Eclipse启动以后,会呈现如下图所示的界面:

6.3 选择“File->New->Java Project”菜单,开始创建一个Java工程,会弹出如下图所示界面。

6.4 为项目添加需要用到的JAR包

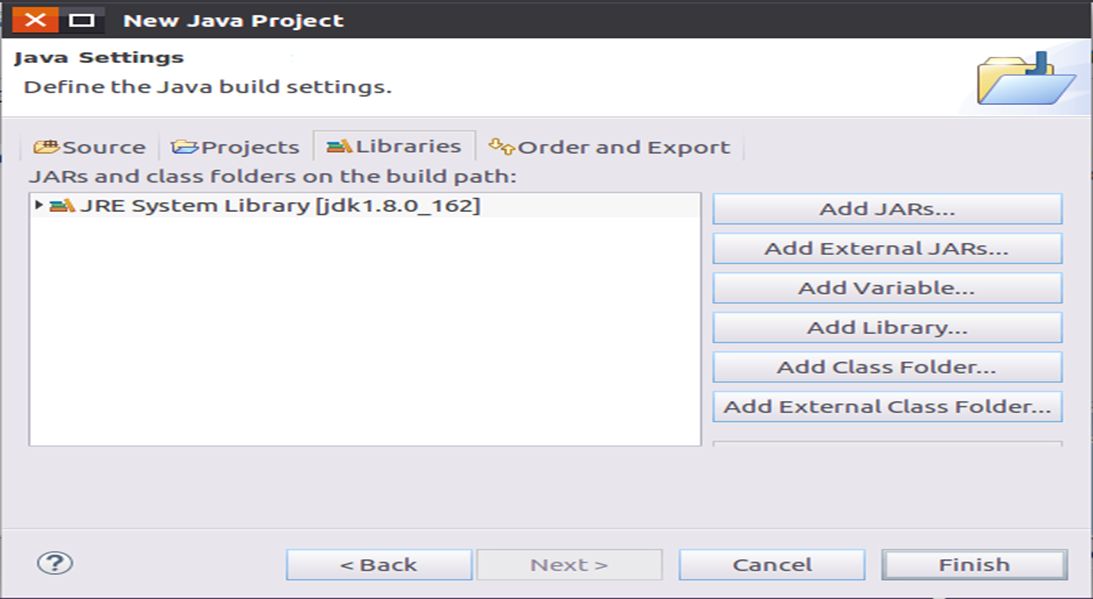

进入下一步的设置以后,会弹出如下图所示界面:

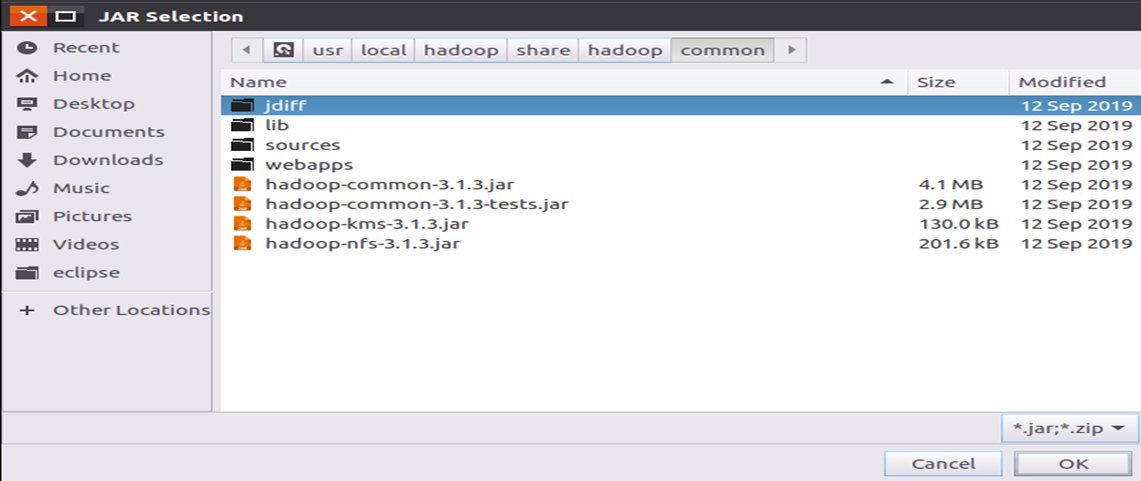

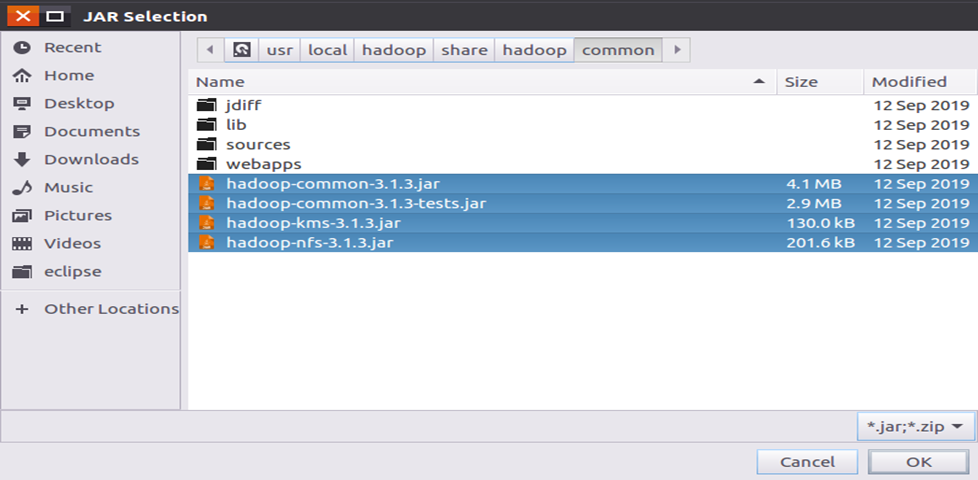

需要在这个界面中加载该Java工程所需要用到的JAR包,这些JAR包中包含了可以访问HDFS的Java API。这些JAR包都位于Linux系统的Hadoop安装目录下,对于本教程而言,就是在“/usr/local/hadoop/share/hadoop”目录下。点击界面中的“Libraries”选项卡,然后,点击界面右侧的“Add External JARs…”按钮,会弹出如下图所示界面。

比如,如果要把“/usr/local/hadoop/share/hadoop/common”

目录下的hadoop-common-3.1.3.jar、hadoop-common-3.1.3-tests.jar、haoop-nfs-3.1.3.jar和haoop-kms-3.1.3.jar添加到当前的Java工程中,

可以在界面中点击目录按钮,进入到common目录,然后,界面会显示出common目录下的所有内容(如下图所示)。

6.1 使用Eclipse开发调试HDFS Java程序

- 编写Java应用程序

下面编写一个Java应用程序,用来检测HDFS中是否存在一个文件。

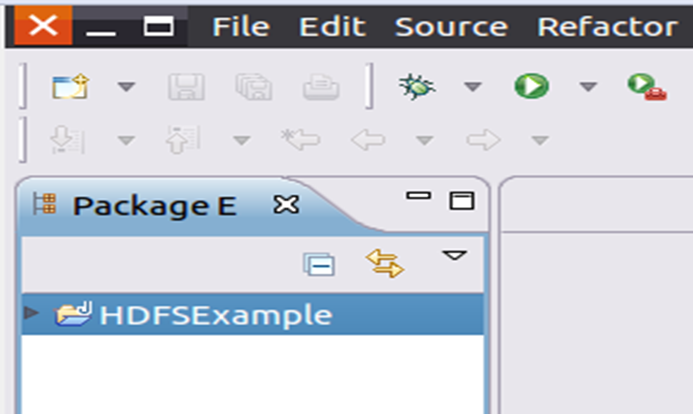

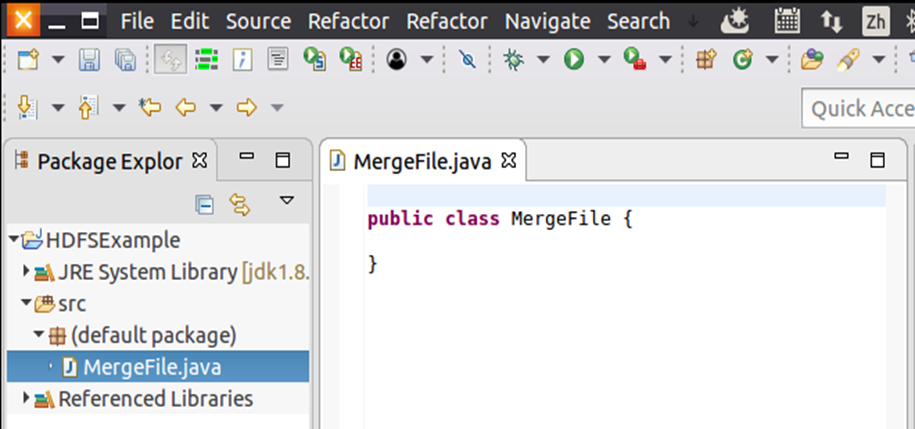

请在Eclipse工作界面左侧的“Package Explorer”面板中(如下图所示),

找到刚才创建好的工程名称“HDFSExample”,然后在该工程名称上点击鼠标右键,在弹出的菜单中选择“NewClass”菜单

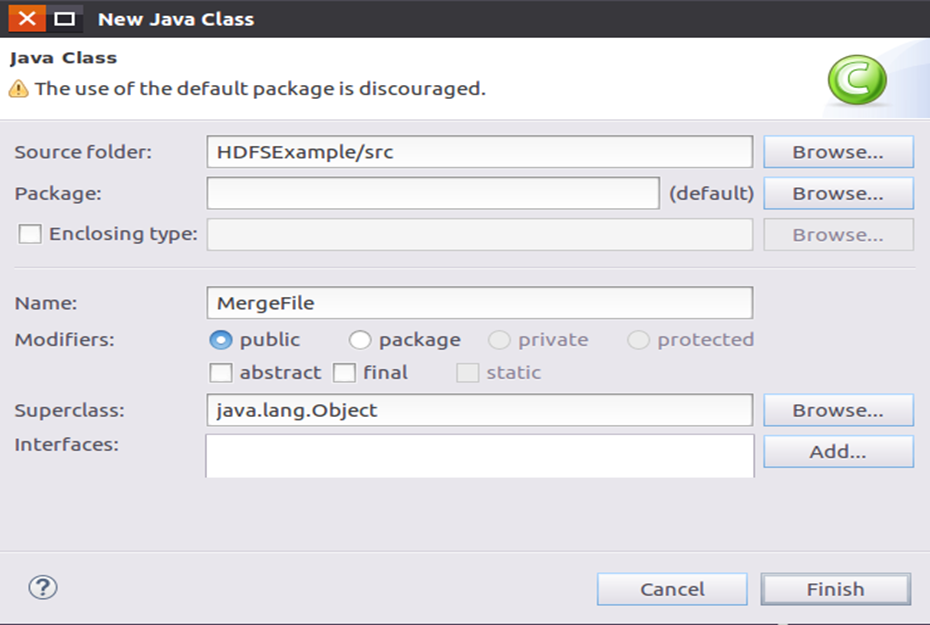

选择“NewClass”菜单以后会出现如下图所示界面:

在该界面中,只需要在“Name”后面输入新建的Java类文件的名称,这里采用名称“MergeFile”,

其他都可以采用默认设置,然后,点击界面右下角“Finish”按钮,出现如下图所示界面

可以看出,Eclipse自动创建了一个名为“MergeFile.java”的源代码文件,请在该文件中输入以下代码:

import java.io.IOException;

import java.io.PrintStream;

import java.net.URI;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

/**

* 过滤掉文件名满足特定条件的文件

*/

class MyPathFilter implements PathFilter {

String reg = null;

MyPathFilter(String reg) {

this.reg = reg;

}

public boolean accept(Path path) {

if (!(path.toString().matches(reg)))

return true;

return false;

}

}

/***

* 利用FSDataOutputStream和FSDataInputStream合并HDFS中的文件

*/

public class MergeFile {

Path inputPath = null; //待合并的文件所在的目录的路径

Path outputPath = null; //输出文件的路径

public MergeFile(String input, String output) {

this.inputPath = new Path(input);

this.outputPath = new Path(output);

}

public void doMerge() throws IOException {

Configuration conf = new Configuration();

conf.set("fs.defaultFS","hdfs://localhost:9000");

conf.set("fs.hdfs.impl","org.apache.hadoop.hdfs.DistributedFileSystem");

FileSystem fsSource = FileSystem.get(URI.create(inputPath.toString()), conf);

FileSystem fsDst = FileSystem.get(URI.create(outputPath.toString()), conf);

//下面过滤掉输入目录中后缀为.abc的文件

FileStatus[] sourceStatus = fsSource.listStatus(inputPath,

new MyPathFilter(".*\\.abc"));

FSDataOutputStream fsdos = fsDst.create(outputPath);

PrintStream ps = new PrintStream(System.out);

//下面分别读取过滤之后的每个文件的内容,并输出到同一个文件中

for (FileStatus sta : sourceStatus) {

//下面打印后缀不为.abc的文件的路径、文件大小

System.out.print("路径:" + sta.getPath() + " 文件大小:" + sta.getLen()

+ " 权限:" + sta.getPermission() + " 内容:");

FSDataInputStream fsdis = fsSource.open(sta.getPath());

byte[] data = new byte[1024];

int read = -1;

while ((read = fsdis.read(data)) > 0) {

ps.write(data, 0, read);

fsdos.write(data, 0, read);

}

fsdis.close();

}

ps.close();

fsdos.close();

}

public static void main(String[] args) throws IOException {

MergeFile merge = new MergeFile(

"hdfs://localhost:9000/user/hadoop/",

"hdfs://localhost:9000/user/hadoop/merge.txt");

merge.doMerge();

}

}6 应用程序的部署

下面介绍如何把Java应用程序生成JAR包,部署到Hadoop平台上运行。首先,在Hadoop安装目录下新建一个名称为myapp的目录,用来存放我们自己编写的Hadoop应用程序,可以在Linux的终端中执行如下命令:

cd /usr/local/hadoop

mkdir myapp

Shell 命令

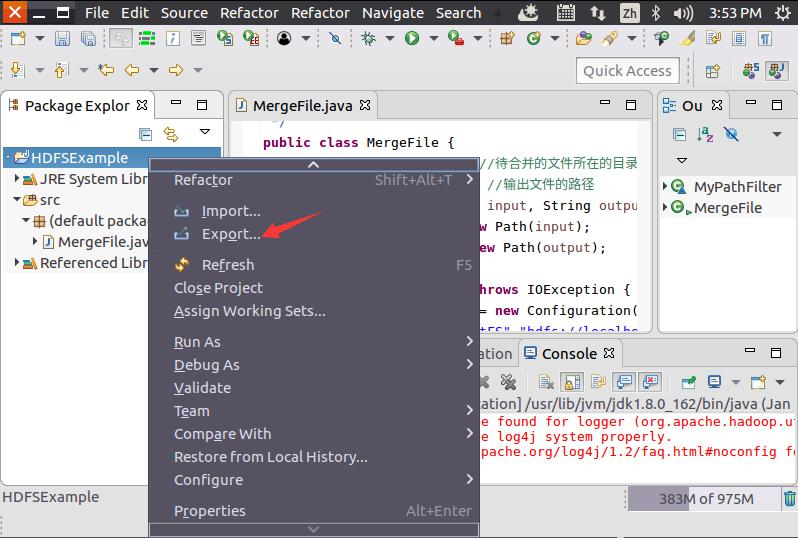

然后,请在Eclipse工作界面左侧的“Package Explorer”面板中,在工程名称“HDFSExample”上点击鼠标右键,在弹出的菜单中选择“Export”,如下图所示。

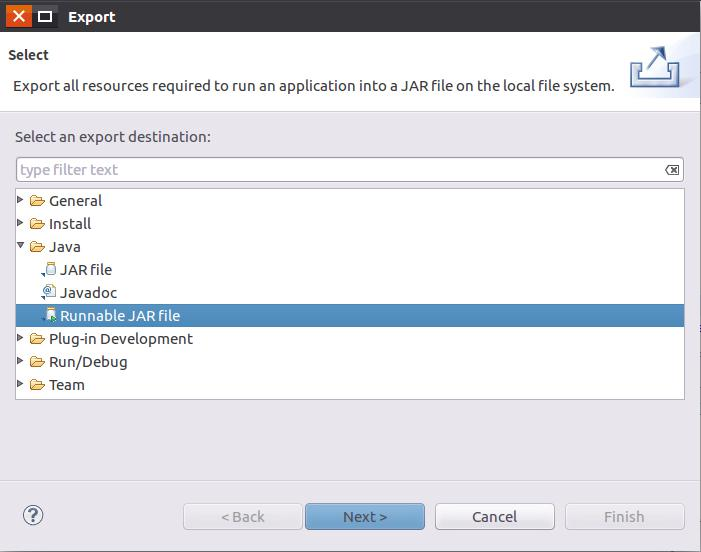

然后,会弹出如下图所示界面。

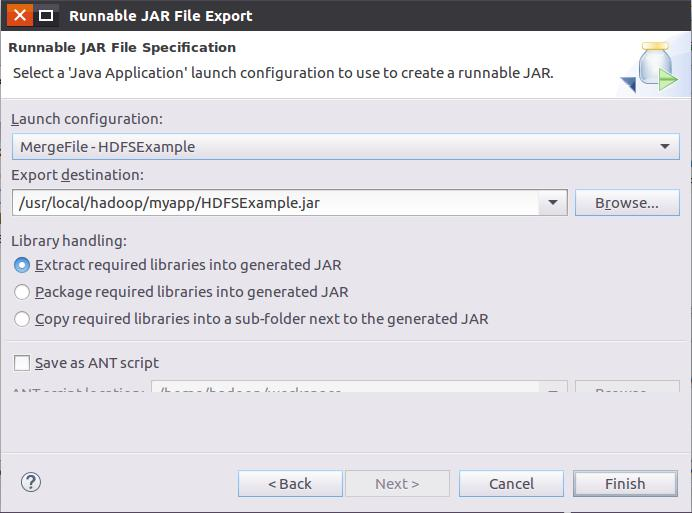

在该界面中,选择“Runnable JAR file”,然后,点击“Next>”按钮,弹出如下图所示界面。

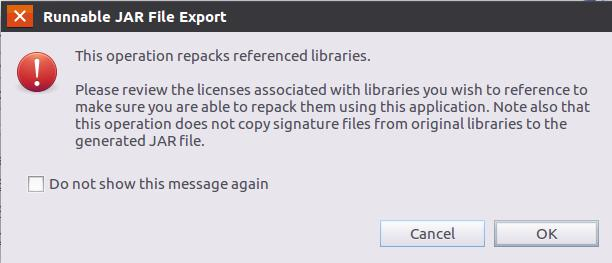

在该界面中,“Launch configuration”用于设置生成的JAR包被部署启动时运行的主类,需要在下拉列表中选择刚才配置的类“MergeFile-HDFSExample”。在“Export destination”中需要设置JAR包要输出保存到哪个目录,比如,这里设置为“/usr/local/hadoop/myapp/HDFSExample.jar”。在“Library handling”下面选择“Extract required libraries into generated JAR”。然后,点击“Finish”按钮,会出现如下图所示界面。

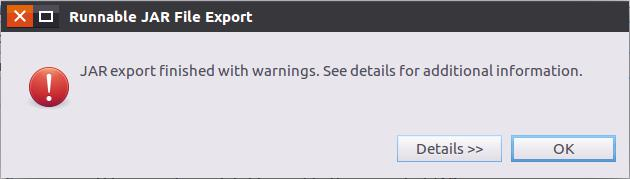

可以忽略该界面的信息,直接点击界面右下角的“OK”按钮,启动打包过程。打包过程结束后,会出现一个警告信息界面,如下图所示。

可以忽略该界面的信息,直接点击界面右下角的“OK”按钮。至此,已经顺利把HDFSExample工程打包生成了HDFSExample.jar。可以到Linux系统中查看一下生成的HDFSExample.jar文件,可以在Linux的终端中执行如下命令:

cd /usr/local/hadoop/myapp

ls可以看到,“/usr/local/hadoop/myapp”目录下已经存在一个HDFSExample.jar文件。

由于之前已经运行过一次程序,已经生成了merge.txt,因此,需要首先执行如下命令删除该文件:

cd /usr/local/hadoop

./bin/hdfs dfs -rm /user/hadoop/merge.txt

现在,就可以在Linux系统中,使用hadoop jar命令运行程序,命令如下:

cd /usr/local/hadoop

hadoop jar MerjerFile.jar

上面程序执行结束以后,可以到HDFS中查看生成的merge.txt文件,比如,可以在Linux终端中执行如下命令:

cd /usr/local/hadoop

./bin/hdfs dfs -ls /user/hadoop

./bin/hdfs dfs -cat /user/hadoop/merge.txtShell 命令

可以看到如下结果:

this is file1.txt

this is file2.txt

this is file3.txt最后编辑:admin 更新时间:2025-03-17 22:00